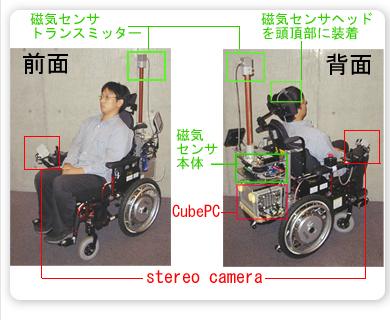

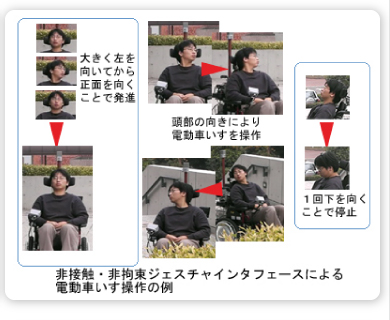

電動車いすのジョイスティック操作に困難が伴う障害者の方々が、人間と同じような2つの眼を持つステレオカメラを用いることで、コードや機器などをいっさい身につけずに、頭部ジェスチャだけで電動車いすを操作できるインタフェースの実現を目指しています。

【障害者の安全で快適な生活の支援技術の開発】

サブテーマ2:重度障害者の自立移動を支援する技術の開発

2-1-(2) 不明瞭な音声やジェスチャからの障害者の要求認識

(非拘束非接触動作認識)

>個別テーマ一覧 >非拘束非接触動作認識

研究代表者:独立行政法人産業技術総合研究所 情報技術研究部門 坂上勝彦・依田育士

ホームページ:依田育士:http://staff.aist.go.jp/i-yoda/yoda-j.html USV:http://staff.aist.go.jp/i-yoda/usv/usv.html

ホームページ:依田育士:http://staff.aist.go.jp/i-yoda/yoda-j.html USV:http://staff.aist.go.jp/i-yoda/usv/usv.html